OpenAI推出新AI「GPT-4o」 可聽可看、即時對話宛若真人

OpenAI於13日發布春季更新資訊,宣布推出新一代AI模型「GPT-4o」,「o」代表的是拉丁語前綴omni,有著全方位的意思,也象徵著此模型處理文字、影像、聲音的能力。

執行長阿特曼(Sam Altman)說明,該模型為原生多模態模型,意即該模型不僅能夠生產文字內容,還能理解語音或影像中的命令。

GPT-4o有什麼新功能?

在語音方面,OpenAI在直播中演示使用者和ChatGPT即時語音對話,甚至在ChatGPT說話時打斷它等2個對AI來說具有挑戰性的真實對話情景,以及即時翻譯英語與義大利、使用不同情感與聲線說話的能力。

執行長阿特曼OpenAI雖然未出席此次更新直播,但他在部落格文章寫道,「感覺就像電影裡的人工智慧一樣……對我來說,過去無法和電腦自然地交談,現在卻可以了。」

此外GPT-4o也擁有分析影像的能力,在OpenAI的演示影片中,其中一位研究人員上傳了一張三角函數的題目影像,並要求該模型一步一步指導他的孩子解題。

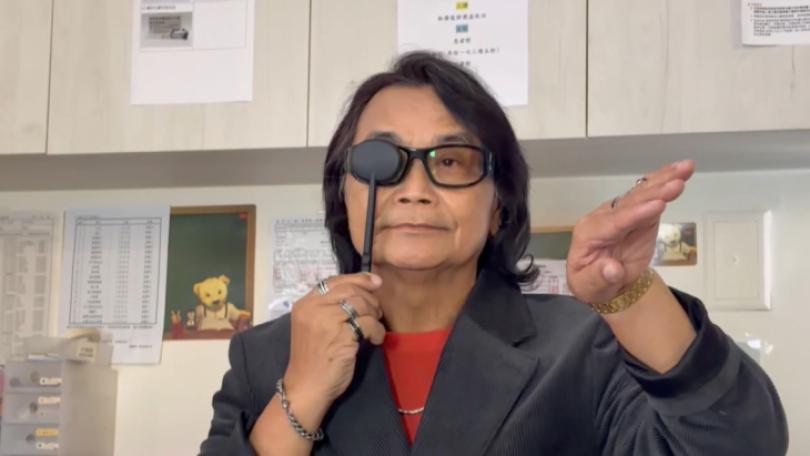

或是使用前鏡頭與GPT-4o即時互動,要求AI分析臉部表情並判斷情緒,AI雖然一開始誤將研究人員的臉誤認為木桌,但要求重新分析後,隨即以充滿活力的女聲回應,「你看起來心情很好,願意分享一下好心情的原因嗎?」

OpenAI也預計在本週推出macOS的桌面應用程式給Plus會員使用,而OpenAI大股東微軟的windows版程式則預計要到年底前才會推出。

技術長穆拉蒂(Mira Murati)表示,「我們只是優先考慮多數用戶的使用平台。」

為什麼要開放免費使用?

與過去GPT-4需付費升級成Plus會員才能使用不同,OpenAI表示將開放GPT-4o給免費使用者,差別僅在Plus會員可搶先體驗、免費版的使用次數為Plus會員的五分之一等。

阿特曼直播後也發文反思OpenAI的發展軌跡,OpenAI最初希望用AI為世界創造利益,但現今他們認為,應提供大眾免費的AI模型及付費API予開發人員使用,「我們將創造AI,然後其他人會用它來創造各種令人驚奇的事物,讓所有人都受益。」

GPT-4o的功能真的創新嗎?

科技顧問公司顧能的分析師德卡特(Chirag Dekate)表示,「OpenAI展示的功能看起來像Google 的Gemini 1.5 Pro發布會中的高級版本,」

德卡特認為,雖然Open AI去年在ChatGPT和GPT3方面擁有先發優勢,但現在能看到他和同行,特別是Google相比已經出現能力差距。

Google今年的開發者年會Google I/O將於台灣時間15日凌晨1時舉行,預期可以看到旗下AI模型Gemini的更新。