Deepfake不只造成數位性暴力 更可能危及國安

發布時間:

更新時間:

網紅涉嫌利用深度偽造技術,移植網紅等人臉部圖像製作色情影片非法牟利,引起軒然大波,更衍生出數位性別暴力問題。有民間團體指出,被害人因為擔心遭到惡意報復,大多不敢報警、提告,更點出查證、追查的難處,更有資安專家提醒,可能會有國安疑慮。

知名網紅小玉日前遭到檢警約談,涉嫌利用DeepFake深度偽造技術,移植網紅和明星等人臉部圖像,製作成色情影片。深偽技術淪為犯罪工具,受害者之一的YouTuber奎丁,就曾經拍攝影片,呼籲正視數位暴力問題。

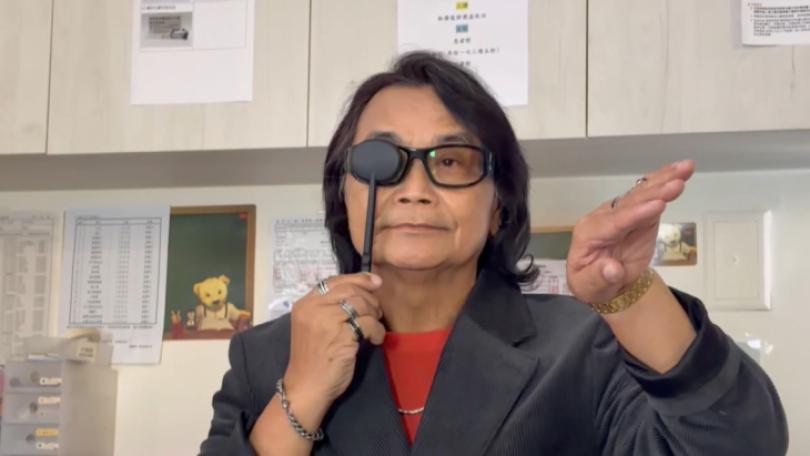

YouTuber 奎丁在影片中表示,「從傻眼到難過,到現在有點憤怒,你憑什麼亂用我的肖像,我們自己更應該去重視,數位科技衍生的新興性別暴力犯罪。」

隨著科技進步,新型態數位暴力犯罪越來越常見,台灣數位女力聯盟表示,擬真技術日新月異,民眾難以查證,不容易分辨真偽,導致誤信,而數位性別暴力不僅對女性造成傷害,甚至想要抓到幕後嫌犯,也有困難。

台灣數位女力聯盟秘書長張凱強指出,「(受害者)不敢出來就是報案或是提告,因為他們擔心就是這樣子的影像,就是沒辦法移除,犯罪集團抓不到人,其實會導致他們被惡意的報復更嚴重,那像Telegram這樣的境外加密公司,其實他們根本不會把這樣子的資料提供給警方,這次查獲是感覺是運氣好。」

數位女力聯盟也坦言,數位性別暴力已經成為全球性問題,深度偽造技術遭到濫用,多年前,美國知名影星蓋兒加朵的影像就曾遭到移花接木,而擬真影片的潛在威脅,有資安專家則坦言可能包含國安。

台科大資管系教授查士朗指出,「就是被偽造的時候,講了一些對某一些族群的一些歧視的發言,那自然而然也會造成,就是說對於那個政治人物的不信任,或者是一些的影響,所以這個技術來說,的確是需要去重視。」

資安專家提醒,這類擬真技術可以任意變造政治人物說詞,誘導民眾相信,很可能被利用來威脅國安等議題上,而多媒體技術發展如何因應科技造假帶來的威脅,成為一大課題。