因拒軍用被列供應鏈風險名單 Claude公司告美國防部

Anthropic在訴狀中指出,美國國防部等聯邦政府部門,將該公司指名為「供應鏈風險企業」的行為非法,並且違反言論自由與程序正義。

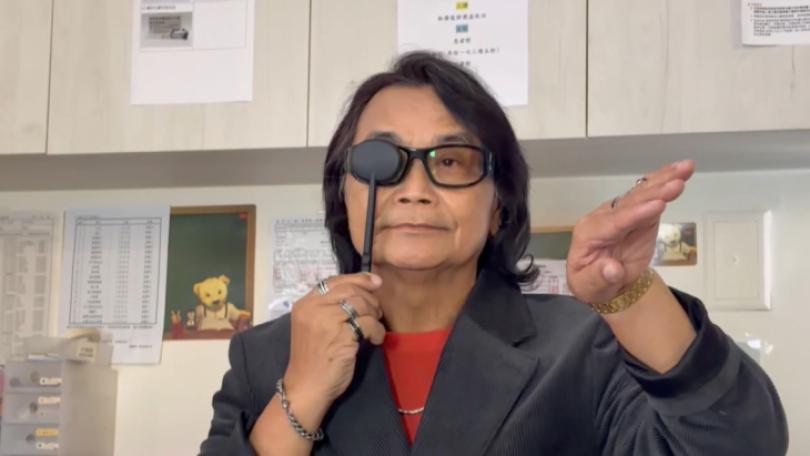

不過,包括Anthropic提告前不久,才與執行長阿莫戴見面的國防部長赫格塞斯等官員指出,不會對訴訟表示任何意見。

總部設於加州舊金山的Anthropic,成立只有短短5年,但在企業等級的人工智慧AI應用市場,占有率已經足以威脅OpenAI的龍頭地位。特別是該公司開發的AI模型Claude,在程式開發領域的市占率更高達54%。

Anthropic執行長阿莫戴2月曾表示,「從正面角度來看,我們有可能治癒幾千年來被認為是不治之症的疾病,大大改善人類的健康。包括第三世界內的幾十億人可望脫貧,為每個人創造更美好的世界。」

Claude因此受到美國軍方重視,目前也是美軍唯一使用在機密決策的AI工具。但Anthropic在設計這套系統時,也置入一套自我檢查機制,名為「憲法AI」,用意是讓使用者確實遵守道德規範,這也為業者與軍方近來的爭端埋下伏筆。

阿莫戴曾說:「從風險的角度來看,我很擔憂AI模型的自主行為,它們可能被個人或政府誤用或濫用,造成經濟弱勢者流離失所。」

根據英國《衛報》與歐洲新聞台等媒體揭露,儘管美國總統川普(Donald Trump)與國防部先後公開批判Anthropic,拒絕與軍方合作是危害國家安全,甚至用「背叛」這樣的字眼來形容,但美軍從1月間對委內瑞拉動武、強行帶走總統馬杜羅,以及2月底聯合以色列對伊朗發動空襲與斬首行動,還是仰賴該公司的AI模型Claude,快速分析大量衛星照片等資料,短時間內鎖定目標行蹤。

Anthropic公司表示,美軍的作為已經跨越業者設定的2條紅線,就是不得用於可完全自主攻擊的武器,也不能用來大量監控美國國內民眾,同時因此被列入供應鏈風險的黑名單,損及企業商譽。

不過市場分析資料顯示,在Anropic公開槓上聯邦政府,以及對手公司OpenAI同意軍方要求後,不少個人消費者與企業用戶對Claude更加信任,導致OpenAI開發的ChatGPT,在AI模型市場的龍頭地位岌岌可危。